5/11/2019

Komendy głosowe wcale nie muszą być dźwiękiem bo mikrofony da się wzbudzić także światłem. Naukowcy już zaprezentowali atak w praktyce pokazując np. otwieranie drzwi garażowych z kilkudziesięciu metrów.

Badacze bezpieczeństwa od dawna interesują się technologiami głosowymi. Po pierwsze są to urządzenia “nasłuchujące”, więc z reguły nagrywa się na nie troszkę więcej niż wynika to z oficjalnych komunikatów czołowych producentów. Wiadomo też, że komendę głosową może wydać ktokolwiek. Badacze czują więc, że wystarczy wymyślić sposób na zrobienie tego w sposób niezauważony. Testowano już możliwość wydawania komend głosowych przy pomocy ultradźwięków i jest to możliwe pomimo filtrowania wysokich częstotliwości we wzmacniaczach stosowanych w urządzeniach (zob. Jak podglądać ludzi i wykradać hasła mikrofonem?).

Light Commands

Teraz wiemy, że jest jeszcze jedno zagrożenie. Mikrofony służą do zmieniania sygnału akustycznego w sygnał elektryczny, ale nowoczesne mikrofony MEMS reagują nie tylko na drgania powietrza. Można je wzbudzić laserem, a odkrycia tego dokonali naukowcy z University of Michigan oraz University of Electro-Communications w Tokio.

Takeshi Sugawara z tokijskiej uczelni jako pierwszy zauważył, że skierowanie na mikrofon MEMS wiązki lasera powoduje emitowanie przez ten mikrofon sygnału odpowiadającemu dźwiękowi określonej częstotliwości. Modulowanie wiązki lasera przekładało się na zmiany w sygnale emitowanym przez mikrofon. Co ciekawe, kolor i długość fali światła nie miały znaczenia dla uzyskiwanego efektu. Istotne jest modulowanie strumienia światła pod względem intensywności.

Naukowcom szybko przyszło do głowy, że odkrycie można wykorzystać do ataku. Co istotne, może być to atak wykonany zdalnie i niezauważalnie. Owszem, potrzebna jest łączność optyczna z celem oraz pewna wiedza na temat atakowanego urządzenia, ale współczesne smartfony to urządzenia ogólnodostępne więc można je kupić i zbadać. Co istotne, trzeba precyzyjnie nacelować laser na odpowiednie miejsce w urządzeniu. To może być poważna przeszkoda przy realnym ataku.

“OK Google! Otwórz drzwi do garażu”

Naukowcom udało się dokonać ataków na różne asystenty głosowe – Google, Amazona (Alexa), Facebooka (Portal) oraz Apple (Siri). Poniżej przykładowy atak, którego celem było wydanie komendy otwarcia drzwi garażowych.

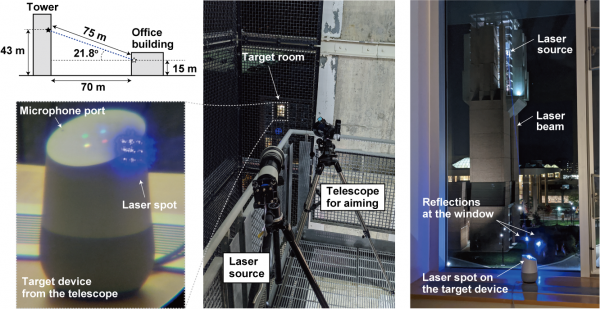

Obrazek poniżej pokazuje jeden z bardziej efektownych testowanych scenariuszy. Atakowano urządzenie znajdujące się w budynku obok, w odległości 75 m. Przy takim ataku udało się wydać komendę otwarcia drzwi garażowych dla Google Home, a okna dwóch budynków najwyraźniej nie przeszkodziły.

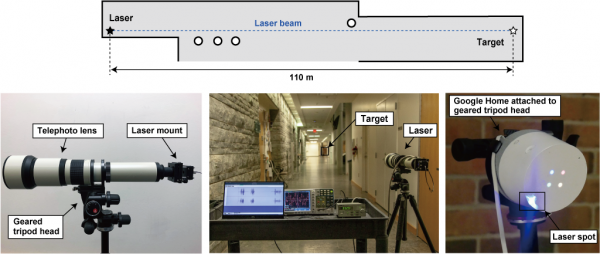

Testowano też atak w korytarzu o długości 110 m. Atak się udał tzn. atakowanie urządzenie powiedziało która jest godzina. Nie wiadomo czy jest możliwy atak w dłuższym korytarzu bo naukowcy nie mieli takiego do dyspozycji.

Czy to jest groźne?

Pomyślmy. Wydając odpowiednią komendę urządzeniu sterowanemu głosowo można…

- kontrolować urządzenia w domu,

- otwierać drzwi do garażu,

- dokonywać zakupów online,

- zdalnie otwierać i uruchamiać niektóre pojazdy,

- otwierać niektóre zamki podając PIN metodą brute force.

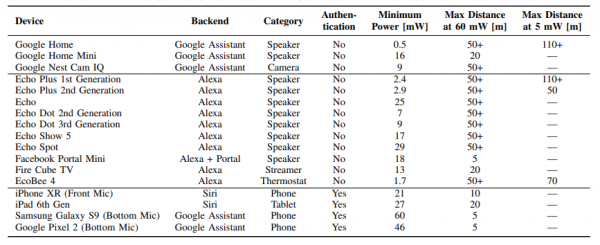

Tabela poniżej podsumowuje wyniki ataków na różne urządzenia.

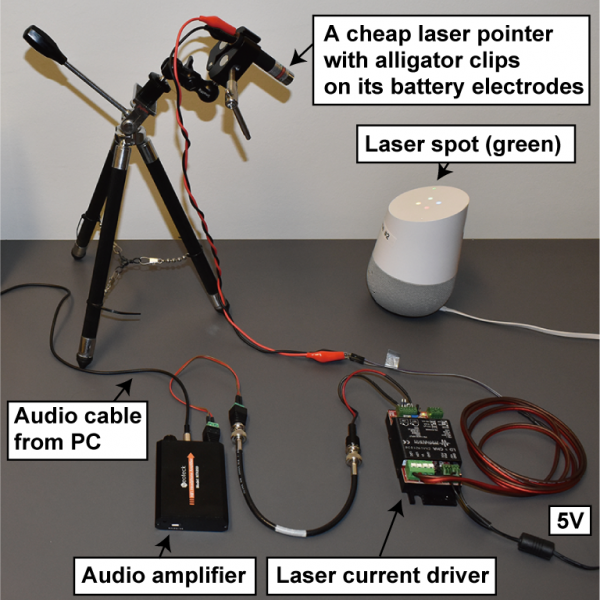

Sprzęt użyty do ataków nie jest może amatorski i całkiem tani, ale nie jest też bardzo drogi czy niedostępny. Naukowcy użyli prostych wskaźników laserowych za kilkanaście dolarów z Amazona, sterownika diody laserowej Wavelength Electronics LD5CHA (340 dolarów), wzmaczniacza Neoteck Headphone (ok. 30 dol.) i wreszcie teleobiektywu Opteka 650-1300mm (za 200 dolarów, do ataków z większej odległości). Gdyby ktoś koniecznie chciał spróbować to zdjęcie poniżej może pomóc.

Zapobieganie?

Część urządzeń sterowanych głosowo nie rozpoznaje głosu użytkownika. W takich przypadkach atak nie nastręcza problemu. Jeśli chodzi o urządzenia rozpoznające głos to w istocie rozpoznają one tylko frazę “wybudzającą” (np. “Ok Google” lub “Alexa”). Potem można prosić urządzenie o różne rzeczy. Co więcej, według naukowców rozpoznawanie głosu nie zawsze działa i można je ominąć używając narzędzi do syntezy mowy.

Teoretycznie na atak narażone są wszelkie urządzenia sterowane głosowo o ile korzystają z mikrofonów w technologii MEMS.

Producenci mogą w przyszłości zabezpieczyć urządzenia przed atakiem. Naukowcy sugerują korzystanie z prostych haseł głosowych do niektórych czynności (mogą to być np. losowo wybierane pytania). Interesującym środkiem zapobiegawczym byłoby również nasłuchiwanie komend na więcej niż jednym mikrofonie, ewentualnie należałoby rozważyć takie umieszczenie mikrofonu w urządzeniu by nie dało się na niego łatwo poświecić.

Co robić? Jak żyć?

Atak jest trudny do wykrycia. Zgadujemy, że niepozostawianie urządzenia na widoku i bez nadzoru powinno pomóc. Wiemy, że niektóre urządzenia z zasady stoją na widoku. Zastanówcie się, czy naprawdę potrzebujecie do nich sterowania głosowego (zob. Amazon Echo nagrał prywatną rozmowę i udostępnił ją bez wiedzy właścicieli)

Więcej informacji?

Szczegóły techniczno-naukowe opisano w artykule pt.Light Commands: Laser-Based Audio Injection Attacks on Voice-Controllable Systems. Znajdziecie go na stronie Lightcommands.com, gdyż ten atak ma już swoją nazwę (Light Commands), swoją stronę i nawet ma swoje logo (to widoczne poniżej)! Dostępne są również filmy na YouTube.

Weź udział z kolegami w jednym z naszych 8 cyberwykładów. Wiedzę podajemy z humorem i w przystępny dla każdego pracownika sposób. Zdalnie lub u Ciebie w firmie. Kliknij tu i zobacz opisy wykładów!

Weź udział z kolegami w jednym z naszych 8 cyberwykładów. Wiedzę podajemy z humorem i w przystępny dla każdego pracownika sposób. Zdalnie lub u Ciebie w firmie. Kliknij tu i zobacz opisy wykładów! Każdy powinien zobaczyć te krótkie szkolenia! Niektóre z nich są darmowe. Wszystkie to praktyczna wiedza i zrozumiały język. 6 topowych tematów — kliknij tutaj i zobacz szczegółowe opisy.

Każdy powinien zobaczyć te krótkie szkolenia! Niektóre z nich są darmowe. Wszystkie to praktyczna wiedza i zrozumiały język. 6 topowych tematów — kliknij tutaj i zobacz szczegółowe opisy.

Myślałem, że jak do tej pory największą wadą było brak autoryzacji głosu (tzn nie ważne czy polecenia wydaję ja czy złodziej…), ale widzę, że polecenia głosowe można wydawać nawet bezgłośnie :D

Świat to sinusoida, może niedługo wrócimy do życie prostego cyfrowo. W domu, nie inteligentnym da się przecież komfortowo żyć, jaki to problem otworzyć bramę garażową, drzwi i światło zwykłym kluczem albo przyciskiem? Odejście od tego przesadzonego cyfrowego komfortu, będzie dla wielu znacznie łatwiejsze niż czytanie i wdrażaniem zaleceń niebezpiecznika ;-)

@basia

Świat to nie jest sinusoida. Sinusoida to wykres funkcji sinus w układzie prostokątnym. Świat jest nieco bardziej złożony.

Wiecie może dlaczego wczoraj były awarie w PKO, Pekao, Santander, mBank, ING ?

https://www.spidersweb.pl/2019/11/nie-dziala-ing-bank-pekao-mbank-santander-pro-nazwa.html

Jestem szczęśliwym nieposiadaczem tego typu wynalazków nie chcąc być niewolnikiem swojego własnego “inteligentnego” domu. Kiedyś złodziej musiał się trochę natrudzić, coś uszkodzić czy zniszczyć żeby się dostać a teraz wystarczy, że ma ze sobą smartfon czy laptop i trochę oleju w głowie a zamki otwierają się same…

Kiedyś… już setki lat temu działało wypowiedzenie “Sezamie, otwórz się” (tyle, że chyba po arabsku). Działało też otwieranie wyjścia na hasło “k… mać”, to już po polsku.

Raczej pęseta lub spinacz oraz wkrętak PH2 a bramy i garaże na sterownikach Hormanna oraz CAME nie stanowią żadnego problemu jeśli fizyczny dostęp do centralki nie jest odpowiednio zabezpieczony. W większości nie jest, a co gorsza domorośli spece spinają je niejednokrotnie razem kanałem dodatkowym. Wiem bo podpinam pod to dostęp ze smartfona (kurierowi otworzyć panie) i uświadamiam że to idiotyczny pomysł. Lecz klient nasz pan…

BTW, czy to działa w drugą stronę i głosem można sterować urządzeniami sterowanymi na podczerwień?

Tak – jak sobie zmajstrujesz urządzenie, które bedzie odbierać polecenie głosowe i na rozkaz wysyłać konkretną sekwencję mrugnięć IR (na przykład, za pomocą LIRC).

Tylko… Po co? Poza efektem “wow, zamienili pilota do TV na komendy głosowe”, praktyczne zastosowania są mizerne.

Wystarczy odejśc od “ok google” na własną frazę wzbudzającą system automatyki. Sterowanie głosem było dostępne na długo przed google assistant

Może nasza rodzima alternatywa Spikit

Moje początki zabawy głosem sięgają Perlbox Voice poradniki do dziś w sieci

https://ubuntu.pl/czytelnia/2007/02/02/ubuntu-sterowany-glosem-perlbox-voice/

w pakiecie z Dell WYSE D200 mamy za ok 30zł asystenta który na dzień dobry potrafi ciut więcej niż te gotowce. Po kilku dniach zabawy taki PC wraz z odpowiednimi układami I/0 może naprawdę dużo.

Ok. Po(d)słuchamy Cię i wydamy laserem kolejne polecenie, gdy nie będzie Cię w domu ;-)

To całe sterowanie głosowe, szczególnie w tzw. inteligentnym domu to rak.

Podsłuchać zawsze można ale z tym laserem to raczej przypał będzie.

Raz. Nie te mikrofony – pomijam fakt :)

Dwa. Wcelowanie do ukrytego w suficie mikrofonu dość karkołomne wyzwanie.

Trzy. “Ej Malina” nie lubi jak jej ktoś obcy rozkazuje i pewnie odpowie tradycyjnym “nie tym tonem…”

PS słabsze punkty do otwarcia garażu są tuż przy bramie. A dokładniej w jej sterowniku.

W swoim życiu widziałem już niejednokrotnie dodatkowy przycisk pilota spięty ze sterownikiem ręcznego otwarcia garażu – przycisk dzwonkowy. Wystarczy ich zwarcie i sezamie otwórz się, wpierw brama a później garaż :(

Wygląda na to, że w ostatnim akapicie linki są pomieszane. Artykuł wskazuje na logo a strona na artykuł.

Podoba mi się koncepcja nasłuchiwania komend na więcej niż jednym mikrofonie. Tylko ciekawe czy producenci nie uznają, że dołożenie drugiego to już za drogo.

“Co istotne, trzeba precyzyjnie nacelować laser na odpowiednie miejsce w urządzeniu.” – czyli w praktyce atak nie wykonalny. Jak zwykle zresztą.

Prościej użyć głośnika i zaatakować w lecie jak okna są otwarte.

Pfff… dużo większym problem, co już pokazano na przykładzie kamer, podobne techniki będą w przypadku centralnie sterowanych samochodów, zwanych nie wiadomo dlaczego autonomicznymi.

+1 za “centralnie sterowane” :-)

Samochody autonomiczne, nie są centralnie sterowane.

Heh, konkurencja od “koguta” napisała o tym dzień wcześniej, ale zasiali większa panikę, bo nie wspomnieli, że sprzęt musi mieć mikrofon MEMS, a na zwykłem elektretowym nie zadziała.

A wystarczy odpowiednio obudować mikrofon, by wiązka laserowa do niego nie miała jak dotrzeć.

A wystarczy odpowiednio obudować mikrofon, by nie miał styczności z laserem.

Pól metra betonu wystarczy?

probowalem laserem, ktorego uzywam do zabawy z kotem …. nie udalo sie

[…] się w innym budynku w odległości 75 metrów, jak donosi portal Niebezpiecznik.pl. Dzięki laserowi wydano komendę i Google Home otworzył drzwi garażowe. To, […]

[…]ewentualnie należałoby rozważyć takie umieszczenie mikrofonu w urządzeniu by nie dało się na niego łatwo poświecić. […]

Do ataków w świecie rzeczywistym zostanie użyty laser na podczerwień, bo oczy go nie widzą. Chodzi o lasery pompujące lasery światłowodowe lub lasery do światłowodów stosowanych w łączności internetowej. Dysponują one również mocą liczoną w dziesiątkach watów więc o zasięg nie ma się co martwić. Problemem pozostają jedynie drgania budynków (szyby załamują światło) i ruchy powietrza o różnej gęstości.

Zdecydowana większość pospolitych plastików jest zupełnie przeźroczysta dla tego światła. Włącznie z atramentem.

Wystarczy zastąpić mikrofony mems mikrofonami pojemnościowymi.

[…] osiągnięciem w tej dziedzinie był atak Light Commands, który polegał na wydaniu polecenia głosowego za pomocą lasera. Wykorzystywał on zjawisko […]

Haha kurwa ja pierdole, od lat w Polsce stosują na polakach bronie psychotroniczne jak nie dłużej, wykorzystując bronie umieszczone na satelitach teraz już z pomocą wież 5G, milicja w tym siedzi i inne gady, a wy piszecie, że można sobie garaż otworzyć z kilkudziesięciu metrów, hahaha. Nie no nie mogę. Niebezpiecznik wyjarało ci bezpiecznik – STOPZET